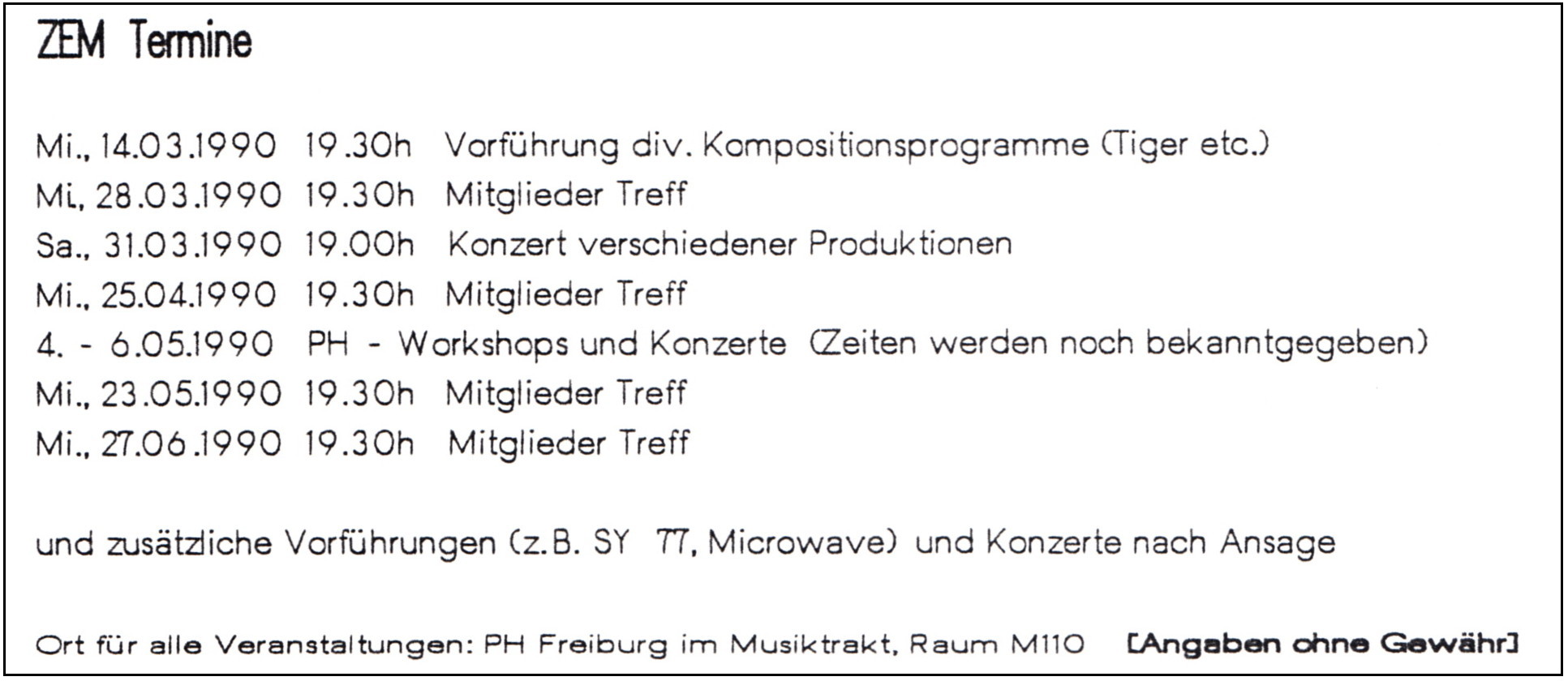

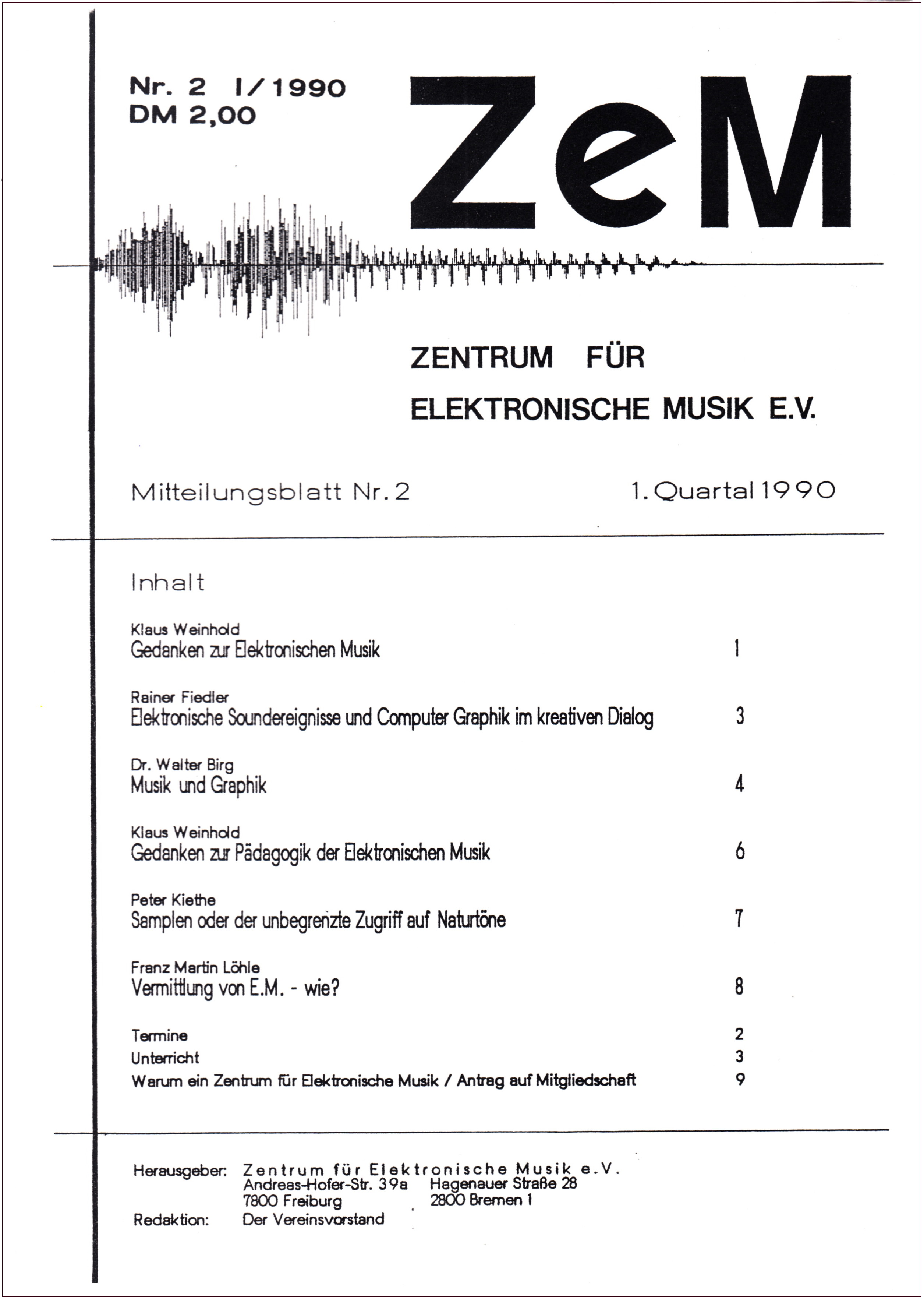

ZeM Mitteilungsblatt Nr. 2 - 1. Quartal 1990

Redaktion: Klaus Weinhold und Franz Martin Löhle

Klaus WeinholdGedanken zur Elektronischen MusikIm ersten Heft unserer Zeitschrift warf ich in einer Betrachtung der Elektronischen Musik die Frage auf, ob diese in der Musikpädagogik eine Chance hätte, und verneinte diese Möglichkeit. Elektronische Musik ist, sofern man die ihr innewohnenden innovativen Möglichkeiten erkennt und auch nutzt, "programmiert", nicht nur "neue Kunst", sondern neueste, vielleicht sogar alternative Kunst. Sie enthält erstmals in der Geschichte der Musik die Möglichkeit, sich von historisch- traditionellen Mustern radikal zu lösen oder zumindest der klassischen Musik etwas radikal Neues hinzuzufügen. Ortega y Gasset schreibt in einem 1925 erschienenen Artikel "Die Vertreibung des Menschen aus der Kunst"(1) - was für die Elektronische Musik wirklich wörtlich zu nehmen ist, denn die "Handhabung" und "Singbarkeit" der klassischen Musik ist radikal durch Maschinen ersetzt -, über diese: "Die neue Kunst aber hat die Masse gegen sich und wird sie immer gegen sich haben. Sie ist wesentlich volksfremd; mehr als das, sie ist volksfeindlich. Jedes beliebige Erzeugnis der neuen Kunst ruft bei der Masse ganz automatisch eine merkwürdigen Effekt hervor. Er spaltet sie in zwei Parteien, eine kleine von wenigen Geneigten, eine große zahllose von Feinden (wobei wir die fragwürdige Fauna der Snobs unberücksichtigt lassen). Das Kunstwerk wirkt also wie ein soziales Scheidewasser, das zwei gegensätzliche Gruppen schafft; aus dem ungegliederten Haufen der vielen sondert es zwei Kasten aus." (S.8)Damit ist zu unserer Entlastung ein Grund gegeben für die zu erwartende Erfolglosigkeit und pädagogische Chancenlosigkeit (bei Menschen), die korrespondiert mit einer enormen Entwicklung bei der Beherrschung von Soundmaschinen. Ortega y Gasset fährt fort: "Wenn die neue Kunst nicht für jedermann verständlich ist, besagt das, daß ihre Antriebe nicht die allgemein menschlichen sind. Es ist keine Kunst für die Menschen überhaupt, sondern für eine sehr besondere Gruppe von Menschen, die vielleicht nicht mehr taugen als die anderen, jedenfalls aber von ihnen verschieden sind." (S.10)Das Stichwort ist gegeben: Der Mensch will in der Kunst den Menschen. Doch: Wo ist bei der Produktion der Elektronische Musik der Mensch? Wo ist er beim Hören der Elektronischen Musik? Der Mensch ist ein organisches System, analog dazu kann man ein klassisches Musikwerk im übertragenen Sinn als ein solches, in dem alles in vielfältiger Weise aufeinander bezogen ist, bezeichnen. Dem gegenüber steht das "Anorganische", die anorganischen Sounds als quasi nackte Naturphänomene. Ortega y Gasset sagt dazu: "Die Neuen haben jede Einmischung des Menschlichen in die Kunst für 'Tabu' erklärt. Das Menschliche, der Inbegriff der Elemente, die unsere Umwelt ausmachen, gliedert sich in drei Stufen. Die erste ist die Stufe der Personen, die zweite die der Lebewesen, die dritte die der anorganischen Dinge. Die Energie des neuen Veto in der Kunst ist proportional zu dem Rang des betreffenden Gegenstandes in dieser Wertfolge. Das Persönliche, da es das Menschlichste des Menschlichen ist, wird am strengsten gemieden. In der Musik und der Dichtung tritt das deutlich hervor. Von Beethoven bis Wagner waren die persönlichen Gefühle des Musikers das Thema der Musik. Der Musiker türmte gewaltige Klanggebäude auf, um darin seine Autobiographie unterzubringen." (S.19)Das soll genügen zur Standortbestimmung der Elektronischen Musik. Doch die Analogien gehen noch einen Schritt weiter. Mallarmé war einer der ersten Künstler des 19. Jahrhunderts, der das "natürliche Material" ablehnte. Er schuf kleine lyrische Stücke, die so in der menschlichen Flora und Fauna nicht vorkamen. Diese Dichtung braucht nicht gefühlt zu werden, es gibt in ihr nichts Menschliches, auch kein Pathos. Wenn sich schon Sprache in eine unmenschliche Ebene transponieren läßt, um wieviel leichter muß das möglich sein mit dem ohnehin abstrakten Sound, sofern er nicht durch System, Code und Tradition vermenschlicht wurde. Kleine "Soundstücke" abstrakter Art, in denen nicht die Seele spricht, sondern die Kombination der gegebenen Elemente. Was ist in der Musik das "natürliche Material"? Zweierlei: Es ist der Code des geordneten Tonsystems, in dem der Mensch die beängstigende Naturvielfalt des Schalls gebändigt hat und auf ganz wenige Elemente zurückgeschnitten hat, und es sind die Werke in diesem System, die dem unreflektierenden Hörer geradezu naturgegeben und ewig erscheinen. Und diese Natur der Kultur, die eben keine Natur ist, hebt die Elektronischen Musik radikal auf. Sie erreicht die Beherrschung der Natur nicht durch Kodifizierung und Systematisierung, sondern durch die Potentialität, d.h. die Möglichkeit, in der Natur der Dinge (hier des Schalls) und der Kultur der Dinge (hier der Werke) zu arbeiten, zu stören, zu bauen, zu transponieren. Die erste Transposition solcher Art von Natur in artifizielle Maschinenkultur war die Übertragung der Gesanglichkeit auf eine vor vierhundert Jahren damals hoch artifizielle Maschine: die Orgel. Diese übernahm, nahezu problemlos, die Stimmen, stellte sie dar, mutierte sie, alterierte sie, schuf aus dem einfachen menschlichen Stimmgefüge eine instrumentale quasi unmenschliche Fuge, die nur auf der Maschine Orgel darstellbar war. Für uns ist diese Vertreibung des Menschen aus der Kunst eine Selbstverständlichkeit. Die Orgel hatte jedoch Verbindung zu ihrer geschichtlichen Grundlage, zur menschlichen Kunst des Gesanges, nie erfolgte eine radikale Ablösung von dieser Vorlage. Anders die Elektronische Musik: Die Tasten eines Synthesizers und manche Aufschriften "Piano" oder "Trompete" erinnern an die Herkunft aus der Musikgeschichte, aber dahinter, bei den Zerlegungen, den "Samplewörtern", den "Frequenzverhältnissen" und möglichen Neuzusammensetzungen, da liegen die Chancen der Elektronische Musik und damit die endgültige "Vertreibung des Menschen aus der Kunst". Die Orgel hat nur selten zu ihrer eigentlichen Potentialität gefunden, sie blieb abhängig von ideologischen Rahmenbedingungen und geschichtlichen Vorbildern. Nur in wenigen Fällen fanden Komponisten mit ihren Instrumenten zu den schier grenzenlosen Möglichkeiten der Orgel. Erwähnt seien hier Viernes Orgelsymphonien oder Ligetis Komposition "Volumina". Ob die Elektronische Musik sich befreien kann von der Last des "natürlichen Materials", bleibt abzuwarten. Dies zu erreichen, wird eine der Aufgaben unseres Vereins sein. (1) Ortega y Gasset: Die Vertreibung des Menschen aus der Kunst, Auswahl aus seinem Werk, DTV München 1964

↑Dialoge sind möglich, wenn deren Teilnehmer über ähnliche kommunikative Elemente und Inhalte verfügen. Ein kreativer Dialog bewegt sich auf einer Ebene, auf der sich die Teilnehmer z.B. im ästhetischen Bereich zu einem künstlerischen Ganzen finden können. Digitale Bilderwelt, vom Computer generiert, sowie elektronische Soundereignisse, gehören in den ästhetischen Bereich. Beide Komponenten werden in zunehmendem Maße vermarktet, die Sensibilisierung dafür steigt ständig. Sie haben einen hohen künstlerischen Level erreicht und stellen moderne, zeitgemäße kreative Werkzeuge und Inhalte dar. Verglichen mit dem Tonfilm, wo die begleitende Musik, die Geräusche und Klänge die Bilderflut stützende Elemente sind, erreichen Computergraphik und elektronische Sounds im Dialog leichwertigkeit. Im kreativen Dialog ergänzen sie sich durch eine ähnliche künstlerische Konstellation sowie Konzeption: Ein Beispiel hierzu wäre Minimal Music im Dialog mit Mandelbrot-Graphiken. Digitale Bilderwelt und computergenerierte Sounds sind medienverwandt: Der gleiche Computer kann die Bilder sowie die Sounds errechnen und die Klangstrukturen arrangieren ebenso deren Verlauf im Soundprozeß. Vorausgeht das Arrangement des Menschen, das Human Interface sozusagen, er greift in den künstlerischen Dialog ein. Traditionelle Mal- und Grafiktechniken werden durch elektronische Malkästen und Klangerzeuger ergänzt. Die Elektronik hilft dadurch mit, das traditionelle Hören von Musik, das visuelle Erscheinungsbild in der Grafik zu verändern, neue Hör- und Sehweisen werden geschaffen. Wie können diese kreativen künstlerischen Dialoge konkretisiert werden? Im "Requiem für Nyxam", einer optischen und akustischen Fantasiereise, versuche ich diesen Dialog zwischen meditativen und abstrakten Sounds (Screenfotos) einerseits und digitalen Bildern andererseits zu erreichen. Der optische Teil dieser Reise wird mit Dias arrangiert, parallel dazu sind Soundevents zu hören. Sie werden durch Tapes sowie live produziert. Die Abläufe im Visuellen und Akustischen sind strukturiert. Die Sounds sind in verschiedene Gruppen gegliedert: abstrakt, meditativ. Fast symmetrisch dazu erscheinen digitale Grafiken: Die Übergänge sind jedoch fließend, auf Perfektion wird verzichtet. Weiter zu nennen wären Computeranimationen, thematisch auf Sounds zugeschnitten. Es wäre auch eine Ausstellung von digitalen Grafiken denkbar, wobei zu jedem Bild, zu jeder Themengruppe ein bestimmter Soundprozeß zu hören wäre. Natürlich könnte man hier auch die Sounds vertauschen, die Freiheit in der orstellungswelt des einzelnen muß gewahrt bleiben. Auch das Fime-Code-Verfahren muß hier erwähnt werden. Sicherlich werden noch weitere Formen dieses Dialogs möglich werden, ein Dialog, der zum Gesamtkunstwerk wird, der zum erweiterten und veränderten Bewußtsein in den Bereichen der visuellen und akustischen Ästhetik des Menschen nicht nur im 21. Jahrhundert wird. Anm. d. Red.: Das „Requiem für Nyxam” wird am 31. März 1990 zu hören und sehen sein [s. Termine].

↑

Für Interessenten bietet ZeEM auf Anfrage MIDI-, Synthezising-, Computer und Sampling-Unterricht für Einzelpersonen oder Gruppen (Anfänger und Fortgeschrittene) an. Der Unterricht wird von erfahrenen E.M. - Produzenten erteilt. Nähere Informationen (Kosten, Leistungen) sind bei Franz Martin Löhle, Emil-Gött-Str. 3, 7800 Freiburg, Tel.:0761/700936 zu erhalten

↑Computerprogramme, die Grafiken erzeugen, gibt es in großer Zahl, und die ästhetische Wirkung dieser Grafiken ist oft unbestreitbar. Die Frage, die uns hier beschäftigen soll, ist nun: Gibt es ein der Grafik entsprechendes musikalisches Korrelat? Wir wollen diese Frage nicht theoretisch klären - es ist zu bezweifeln, ob dies überhaupt möglich ist - sondern wollen in jedem Einzelfall prüfen, ob die ästhetische Wirkung auch musikalisch eintritt. Nehmen wir als Beispiel ein Grafikprogramm, wie es kürzlich in "Spektrum der Wissenschaft" (2/90) publiziert wurde. Es handelt sich um ein Programm, welches ein sich spiralartig drehendes Polygon zeichnet. Das Programm lautet nach Omikron-Basic übertragen und mit einigen Zusätzen versehen: 100 '============================

Betrachten wir dieses kleine Programm, so erkennen wir, daß zunächst zwei Felder P und Q demissioniert werden, die die Punkte enthalten. Dann wird die Computermaus eingeschaltet und der Schirm gelöscht (Zeile 260) Danach werden mit Hilfe der Maus bis zu 100 Punkte eingegeben (Zeilen 270-440). Die Zeilen 480-720 enthalten nun das eigentliche Programmzentrum mit Zeichnung und Tonausgabe: Die N Punkte, die eingegeben wurden, werden gezeichnet und mit den beiden Biosbefehlen wird der Synthesizer ein- und wieder ausgeschaltet. Dazwischen muß natürlich noch eine definierte Zeitspanne liegen, die mit dem Wait-Befehl (Zeile 660) erreicht wird. Dabei wird noch ein Zähler hoch gezählt, der bei Erreichen einer bestimmten Plygonzahl den Ausgabevorgang unterbricht (Zeile 700). Anschließend erfolgt eine kleine Koordinatentransformation der ursprünglichen Punkte P(M,1) und P(M,2) (Drehstreckung!) in den Zeilen 820-840. Die neu berechneten Punkte werden an die Stelle der soeben gezeichneten gesetzt (Zeilen 940-960) und das Spiel mit Ausgabe der Zeichnung und der entsprechenden Töne wiederholt. Betrachten wir die eigentlichen Musikbefehle noch etwas genauer! Der Befehl Bios(,3,3,X) übergibt an den Computerport 3, das ist die Midi-Schnittstelle beim Atari, den Zahlenwert X. Es werden in Zeile 640 also die drei Werte 144 =Note on, W!*P(M,1)+40, und die Zahl 64 als Velocity an die Midi-Schnittstelle gesendet. Die Zahl W!, die am Anfang des Programms = 0.12 gesetzt wurde, transformiert die Polygonkoordinate P(M,1) in einen vernünftigen Bereich und der Wert +40 soll verhindern, daß die Midi-Notenwerte unter 40 sinken. Zeile 680, die den gerade gespielten Ton wieder ausschaltet, ist bei manchen Synthesizern übrigens nicht nötig: Der 17. Ton schaltet den ersten wieder aus, der 18. den zweiten usw. Die Abspielgeschwindigkeit hängt fast nur von dem Wait-Parameter(Zeile 660) ab! Zum Experimentieren stehen nun einige Parameter zur Verfügung und

es sollte ausgiebig Gebrauch davon gemacht werden! Um hier einige Ideen

anzuregen: Es kann anstelle der X-Koordinate (P(M,1)) die y-Koordinate

(P(M,2)) oder gar alle beide verwendet werden. Oder es kann eine Klangumschaltung

erfolgen mit Bios(,3,3,192) :Bios(,3,3,P(M,2)), oder es kann abhängig

von der Koordinatenlage die Geschwindigkeit geändert und damit ein

Rhythmus erzeugt werden.....

Zum Schluß noch ein Hinweis auf Grafik-Programmideen: In der Zeitschrift

"Spektrum der Wissenschaft" gibt es eine Rubrik "Computer-Kurzweil".

↑Wer vor ca. 30 Jahren Musik studierte, fand im wesentlichen die gleichen Rahmenbedingungen vor wie heutzutage: Akustische Instrumente und als "Programme" die in Druckerzeugnissen kodifizierten Werke der klassischen Komponisten, verbunden mit einem Wertekanon, der sich in den letzten 200 Jahren gebildet hatte und der, nahezu unverändert weitergegeben, bis heute unumstößlich wirkt. Der Interessent Elektronischer Musik erlebt eine geradezu entgegengesetzte, geschichtslose, stets weiterschreitende, sich verändernde Soundwelt, die weder ein festes Instrumentarium, noch ein Repertoire gängiger Konvention der Gestaltung aufweist. Wie soll man heute an elektronische Instrumente herangehen, was auf ihnen spielen? Dabei müßte der Ausdruck "spielen" gedeutet werden: Spielt z.B. der Computer? Diese neuen Umstände erfordern ein gänzliches Umdenken, eine Perestroika bzgl. der Produktion von Elektronischer Musik mit allen Konsequenzen für die zukünftige Musikpädagogik. Zwei Wege sollen kurz aufgezeigt werden: 1. Der Weg der Entwicklung der Elektronischen Musik wird in groben Schritten anhand des meist noch vorhandenen älteren Instrumentariums nachvollzogen. Der Lernende wird mit einem klassischen Modulsystem bekanntgemacht. Nach wie vor bietet sich hier der EMS-Logik-Synthesizer an, mit dem alle Formen der elektronischen Synthese vollzogen werden können. Insbesondere seien die Formen der Hüllkurven von Klängen (Pitch und Amplitude), die eine ganz entscheidende Rolle bei der Soundprogrammierung spielen, hervorgehoben und die Gestaltung der additiven und multiplikativen Verknüpfungen von Schwingungen bis hin zur FM-Synthese. Der Studierende lernt hier an relativ wenig Parametern (ca. 20) einen Sound von Grund auf zu realisieren. 2. Der kürzere und umso schwierigere Weg ist die kurzzeitige Einarbeitung in ein aktuelles, gerade auf dem Markt befindliches Instrument (z.B. V50 von Yamaha). Hier bieten sich wieder zwei Abzweigungen an: Entweder man verzichtet gänzlich auf die Erstellung eigener Sounds und beschränkt sich auf die vom Hersteller kreierten, meist nicht besonders reizvollen sog. Preset-Klänge, nützt aber die Steuermöglichkeiten (das Spielen des Instrumentes) des Sequencers voll aus, oder man beginnt mit den meist enormen Möglichkeiten einer zunächst einfachen, aber allmählich schwieriger werdenden Programmierung der Soundparamter, die schließlich zu immer neuen, stets "unerhörten" Klängen führen wird. Der EMS-Synthesizer hat, wie oben erwähnt, ca. 20 Parameter, der neu SY77 von Yamaha wird deren über 1000 haben. Abschließend der Gang einer Synthesizer-Prüfung an der PH Freiburg: Ein Student kaufte sich im Sommer 89 einen neu auf den Markt gekommenen V50 und stieg unmittelbar in die sich aus der Bedienungsanleitung ergebenden Möglichkeiten des Gerätes ein. Er legte den Hauptwert auf die Gestaltung von Stücken, nur am Rande wurden neue Sounds, in FM-Synthese programmiert. "Zurückgegriffen" (im wörtlichen Sinne) wurde auf klassisches Repertoire: 2 Stücke wurden in den Sequencer eingespielt, das Präludium C-Dur von Bach und ein Prélude von Debussy (Minstrels). Der entscheidene neue Gestaltungsimpuls war die Instrumentierung der Stücke durch Werksounds, die sich teilweise hervorragend für die Soundabfolge eigneten. Selbstverständlich stand als Abschluß eine eigene Produktion: Unter Ausnützung des Rhythmus-Gerätes des V50 wurden jazzige Akkorde, Melodien und Rhythmen zu einem individuellen Stück komponiert. Der Spieler wurde hier zum Produzenten und Reproduzenten anderer und eigener Musikvorstellungen. Die "Einsamkeit" des Einspielens und Programmierens wurde sicherlich wettgemacht durch die schier unendlichen Möglichkeiten neuer Zugänge zu musikalischem Spiel und Klang.

↑Fangen wir von Grund auf an. Was ist ein Sampler überhaupt? Eigentlich ist ein Sampler nichts anderes als ein digitales Aufnahmegerät, ähnlich einem CD-Player oder einem DAT-Recorder. Im Unterschied zu den herkömmlichen analogen Aufnahmeverfahren (z.B. Kassettenrecorder, Tonband ...) wird bei digitalen Bandmaschinen der Klang in die Sprache des Computers übersetzt; er wird digitalisiert. Mit einer unbeschreiblichen Schnelligkeit werden Klanginformationen in das Binärsystem übersetzt. Der Computer kann nur zwei Ziffern - Strom an, Strom aus -lesen. Dies alles vollbringt ein sogenannter A/D-Wandler (Analog-Digital Wandler). Nach der Verarbeitung wird die digitale Information durch einen D/A-Wandler zurück in ein analoges Signal verwandelt und im Lautsprechersystem hörbar gemacht. Bis hierhin unterscheidet sich ein Sampler nicht von einem CD-Player. Der große Unterschied liegt bei den Verarbeitungmöglichkeiten. Der CD-Player bekommt mit der Compact Disk seine Digitaldaten vorgeschrieben, und hat nichts mehr mit einer Klangverarbeitung oder besser Klangeditierung zu tun. Beim Sampler können vom Benutzer direkt Klänge aufgenommen werden. Diese gespeicherten Klänge sind für den Benutzer frei verfügbar und können in jeglicher Art und Weise verändert werden. Der große Nachteil hierbei ist die begrenzte Speicherkapazität. Da das Samplen nur einer kurzen Zeitspanne bereits riesige Datenmengen umfaßt, ist die mögliche Zeitspanne eines zu samplenden Klanges relativ begrenzt. Auch bei den heutigen Speicherkapazitäten ist der Speicher bei einer Sampling-Rate von 36 kHz schnell aufgebraucht. Im obigen Abschnitt wurde der Begriff der Sampling-Rate oder Samplingfrequenz verwendet. Hier soll nun erklärt werden, was dies zu bedeuten hat. Die Samplingfrequenz wird in der Einheit Herz angegeben. So sagt beispielsweise die Sampling-Rate von 36 kHz aus, daß der Klang 36000 Mal pro Sekunde abgetastet wird. Je höher dieser Wert ist, um so näher kommt das Resultat dem aufgenommenen Klang, um so mehr Speicher wird jedoch auch benötigt. Ein Sample mit einer Auflösung von 9 kHz hört sich etwa wie ein Klang aus einem alten Transistorradio an, hat jedoch den Vorteil, daß eine längere Zeitspanne gespeichert werden kann. So ist es beispielsweise möglich, bei einer Speicherkapazität von 2 MByte ca. 29 Sek. (Sampling-Rate 36 kHz), oder 116 Sek. (Sampling-Rate 9 kHz) aufzunehmen. Kurzum gibt die Samplingfrequenz die Klangauflösung und damit ihre Qualität an. Als nächstes folgt eine Beschreibung der Editiermöglichkeiten am Sampler. Hier sollen vor allem allgemeine Editiermöglichkeiten angesprochen werden, da jeder Sampler firmenspezifisch seine eigenen Möglichkeiten bietet. Aus einem Sample können Teile ausgeschnitten werden und extra als Klang verarbeitet werden (Truncatefunktion). Bestimmte Samples oder zurechtgeschnittene Klangstücke können beliebig oft wiederholt werden (Loopfunktion). Je nach Art des Samplers können oft sogar 8 verschiedene Loops in einem Klang gesetzt werden. Das Schreiben von Mischklängen oder von Kombinationsklängen

gehört heute ebenfalls zum Standard. Bei Mischklängen werden

zwei verschiedene Samples gleichzeitig wiedergegeben. Sie verschmelzen

ineinander. Bei Kombinationsklängen werden die Samples hintereinander

gespielt.

Allein diese Vielfalt an Editiermöglichkeiten kann ein Beispiel dafür geben, wie kreativ und frei man heute seine Klänge verarbeiten kann. Der Phantasie sind kaum Grenzen gesetzt. Es wäre beispielsweise vorstellbar, das Schreien eines Babys aufzunehmen, tiefer zu transponieren, diesem Schreien den Klang eines D-50 zu überlagern und diesen abgemischten Sound langsam in den Klang einer reversen Cymbal übergehen zu lassen. Es ist immer wieder ein kleines Abenteuer, was für ein Sound am Ende dieser Prozeduren herauskommt. So hört sich das Geräusch einer Stubenfliege 2 Oktaven tiefer eher wie das Fahren einer Kompanie von Panzern an. Nach diesen Ausführungen nun noch ein Wort zu den Controllern. Natürlich sind Tastaturen immer noch die gebräuchlichsten, jedoch müssen sie nicht unbedingt zum Sampler gehören, wie die Nacht zum Tag. Es ist durchaus möglich, seinen Sampler auch mit einem Blasdruckwandler oder Ähnlichem zu steuern. Leider macht sich in letzer Zeit auch ein Trend zum Sampleplayer breit. Ein Sampleplayer ist ein Instrument, in welchem lediglich bereits gesamplete Klänge gespeichert sind, mit dem man diese aber nicht editieren oder selbst neue Klänge samplen kann. Scheinbar ist es den meisten Musikern zu aufwendig selbst ihre Sounds zu erstellen. Ihnen reichen die von der Industrie vorgefertigten Sounds. Das gleiche ist mit dem Presetsynthesizer in der Synthesizerindustrie zu beobachten. Die Möglichkeit der Klangeditierung wird immer enger. Die Industrie stellt sich auf die Konsumenten ein, und solange in der Käuferschicht kein weiterreichendes Interesse am Klangeditieren besteht, wird diese Entwicklung wohl anhalten.

↑Ein Produzent von Elektronischer Musik (E.M.) hat besonders, mehr als alle anderen 'Musiker', daran zu schaffen, das von ihm Produzierte zu Gehör zu bringen und dann auch noch verständlich zu machen. Der Grund hierfür ist einfach: die neue Soundwelt ist 'überwältigend', schockierend. Dies bedeutet nun für ihn, einen Großteil seiner musikalischen Arbeit auch mit dem Erklären von seinen Produktionen zu bestreiten. Zu aller erst steht trotzdem natürlich das Darbieten seiner Musik. In der Regel kann er dies nicht alleine; es sein denn, er ist Kompositionsstudent oder besitzt das nötige 'Kleingeld', um seine Konzerte selbst zu finanzieren. Er braucht also Foren, die ihm die Möglichkeit der Darstellung bieten. Für die Gründungsmitglieder von ZeM war ein wichtiger Gründungsgrund, solch ein Forum zu schaffen, s. nächste Seite. Das Forum ist nun geschaffen. ZeM e.V. ist gegründet und eingetragen. Nun gilt es, die Möglichkeiten, die es bietet, zu nutzen. Jeder, der aktiv seine Vorstellungen von E.M. betreiben und vermitteln will sollte sich überlegen - wie. Hierzu schwirren mir selbst einige Ideen im Kopf herum, die ich in den folgenden Ausgaben vorstellen und diskutieren möchte. Als Musiklehrer (RS) habe ich die Möglichkeit, E.M. in die Schule zu bringen und somit einen wichtigen Personenkreis, die Lernenden, zu erreichen. Ich werde die nächsten Wochen Projekte starten, E.M. nicht nur als Selbstzweck, sondern im Unterricht generell durchzuführen. Hierüber werde ich dann als erstes berichten.

↑Die Elektronische Musik führt in unserer Zeit ein Schattendasein, obgleich ihr technischer Stand einen noch nie dagewesenen Level erreicht hat. Allein in der Unterhaltungsmusik finden die heutigen Elektrophone wie Synthesizer, Sampler und Computer Verwendung, jedoch werden sie hier in der Regel nur zum Imitieren akustischer Instrumente benutzt. Nur von wenigen zeitgenössischen Komponisten wird heute ab und zu reine Elektronische Musik komponiert und produziert. Und trotzdem gibt es viele Laien, Amateure und Halbprofis, die sich intensiv mit Elektronischer Musik praktisch wie theoretisch befassen. Bisher war es hier in Freiburg jedoch hauptsächlich Studenten der PH Freiburg (durch Klaus Weinhold) vergönnt, Elektronische Musik zu studieren und eigene Stücke zur Aufführung zu bringen. Um dies zu ändern und ein Forum für alle interessierten Praktiker und Freunde der Elektronischen Musik zu schaffen, wurde das Zentrum für Elektronische Musik e. V. - ZeM gegründet.

Als Ziele und Aufgaben von ZeM wurden folgende festgesetzt:

[...] Aktuelle Adressen s.u. http://www.zem.de [In der Printausgabe folgte an dieser Stelle das Formular „Antrag auf Mitgliedschaft”]

Titelseite der zweiten Auflage

|

|

© ZeM e.V. | ZeM Mitteilungsblatt Nr. 2 - 1. Quartal 1990

|